Un nou studiu examinează eforturile YouTube de a limita răspândirea teoriilor conspirației pe site-ul său, de la videoclipuri care susțin că vremurile de sfârșit sunt aproape de cele care pun la îndoială schimbările climatice.

Un nou studiu examinează eforturile YouTube de a limita răspândirea teoriilor conspirației pe site-ul său, de la videoclipuri care susțin că vremurile de sfârșit sunt aproape de cele care pun la îndoială schimbările climatice.

Produs de Rumsey Taylor, Alana Celii și Dave Horn

Schimbările climatice sunt o farsă, Biblia a prezis alegerile președintelui Trump și Elon Musk este un adorator al diavolului care încearcă să preia lumea.

Toate aceste ficțiuni și-au găsit viața pe YouTube, cel mai mare site video din lume, în parte, deoarece recomandările proprii YouTube i-au orientat pe oameni pe calea lor.

De ani de zile a fost un megafon extrem de eficient pentru teoreticienii conspirației, iar YouTube, deținut și administrat de Google, a recunoscut la fel de mult. În ianuarie 2019, YouTube a spus că va limita răspândirea videoclipurilor „care ar putea dezinforma utilizatorii în moduri dăunătoare”.

Un an mai târziu, YouTube recomandă teorii ale conspirației mult mai puțin decât înainte. Dar progresul său a fost inegal și continuă să avanseze anumite tipuri de fabricații, potrivit unui nou studiu realizat de cercetători de la Universitatea din California, Berkeley.

Eforturile YouTube de a reduce teoriile conspirației reprezintă un test major al capacității Silicon Valley de a combate dezinformarea, în special înaintea alegerilor din acest an. Studiul, care a examinat opt milioane de recomandări pe parcursul a 15 luni, oferă una dintre cele mai clare imagini de până acum ale acelei lupte, iar rezultatele mixte arată cât de dificilă rămâne problema companiilor tehnologice precum Google, Facebook și Twitter.

Cercetătorii au descoperit că YouTube a aproape eradicat unele teorii ale conspirației din recomandările sale, inclusiv afirmațiile că pământul este plat și că SUA guvernul a efectuat sept. 11 atacuri teroriste, două falsuri pe care compania le-a identificat drept ținte anul trecut. În iunie, YouTube a spus că timpul petrecut de oameni vizionând astfel de videoclipuri din recomandările sale a scăzut cu 50%.

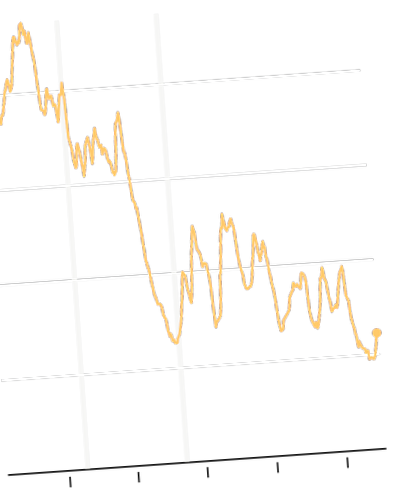

Cu toate acestea, cercetătorii Berkeley au descoperit că, imediat după ce YouTube a anunțat că succesul, recomandările sale despre teoriile conspirației au sărit înapoi și apoi au fluctuat în următoarele câteva luni.

Aceasta este ponderea videoclipurilor conspiraționale recomandate din clipurile de top legate de știri

Datele au arătat, de asemenea, că alte falsuri au continuat să înflorească în recomandările YouTube, cum ar fi afirmațiile că extratereștrii au creat piramidele, că guvernul ascunde tehnologii secrete și că schimbările climatice sunt o minciună.

Cercetătorii susțin că aceste descoperiri sugerează că YouTube a decis ce tipuri de dezinformare dorește să elimine și ce tipuri este dispus să permită. „Este o problemă tehnologică, dar este într-adevăr la sfârșitul zilei și o problemă de politică”, a spus Hany Farid, profesor de informatică la Universitatea din California, Berkeley și coautor al studiului.

„Dacă aveți capacitatea de a conduce, în esență, o parte din conținutul deosebit de problematic aproape de zero, atunci puteți face mai multe lucruri”, a adăugat el. „Folosesc cuvântul„ nu se poate ”atunci când înseamnă„ nu se va ”.”

Farshad Shadloo, un purtător de cuvânt al YouTube, a declarat că recomandările companiei vizează orientarea oamenilor către videoclipuri autoritare care să-i lase mulțumiți. El a spus că compania îmbunătățește continuu algoritmul care generează recomandările. „Numai în ultimul an, am lansat peste 30 de modificări diferite pentru a reduce recomandările privind conținutul limită și dezinformarea dăunătoare, inclusiv dezinformarea schimbărilor climatice și alte tipuri de videoclipuri de conspirație”, a spus el. „Datorită acestei modificări, durata de vizionare a acestui tip de conținut obținută din recomandări a scăzut cu peste 70% în S.U.A.”

Puternicul algoritm de recomandare al YouTube, care îi împinge pe cele două miliarde de utilizatori lunari către videoclipuri pe care crede că le vor viziona, a alimentat ascensiunea platformei pentru a deveni noul televizor pentru mulți din întreaga lume. Compania a declarat că recomandările sale generează peste 70 la sută din cele peste un miliard de ore pe care oamenii le petrec vizionând videoclipuri în fiecare zi, făcând software-ul care alege recomandările printre cei mai influenți algoritmi din lume.

Succesul YouTube a venit cu o latură întunecată. Cercetările au arătat că recomandările site-ului au amplificat sistematic videoclipuri divizive, senzaționaliste și clar false. Alți algoritmi meniți să atragă atenția oamenilor pentru a le arăta mai multe reclame, precum fluxul de știri Facebook, au avut aceeași problemă.

Miza este mare. YouTube se confruntă cu un atac de dezinformare și conținut neplăcut încărcat zilnic. F.B.I. a identificat recent răspândirea teoriilor conspirației marginale ca o amenințare teroristă internă.

Luna trecută, un german a încărcat o șapă pe YouTube spunând că „societățile secrete invizibile” folosesc controlul minții pentru abuzul copiilor din buncărele subterane. Ulterior, el a împușcat și a ucis nouă persoane într-o suburbie din Frankfurt.

Pentru a studia YouTube, dl. Farid și un alt cercetător Berkeley, Marc Faddoul, au făcut echipă cu Guillaume Chaslot, un fost inginer Google care a contribuit la dezvoltarea motorului de recomandare și acum îl studiază.

Din octombrie 2018, cercetătorii au colectat recomandări care au apărut alături de videoclipuri de la peste 1.000 dintre cele mai populare și recomandate canale de știri YouTube, făcându-și studiul printre cele mai lungi și mai aprofundate examinări ale subiectului. Apoi, au instruit un algoritm pentru a evalua, pe o scară de la 0 la 1, probabilitatea ca un anumit videoclip să fi tratat o teorie a conspirației, inclusiv prin analiza comentariilor, transcrierii și descrierii sale.

- Fire Shight se extinde spre nord, amenințând livezile de mere - The New York Times

- Conspiracy (2001) - Rotten Tomatoes

- Teoria Conspirației - Frimley Green Club

- Cardio Tennis pentru a câștiga endorfine și a pierde în greutate - The New York Times

- Teoriile conspirației se răspândesc la fel de repede ca Coronavirusul